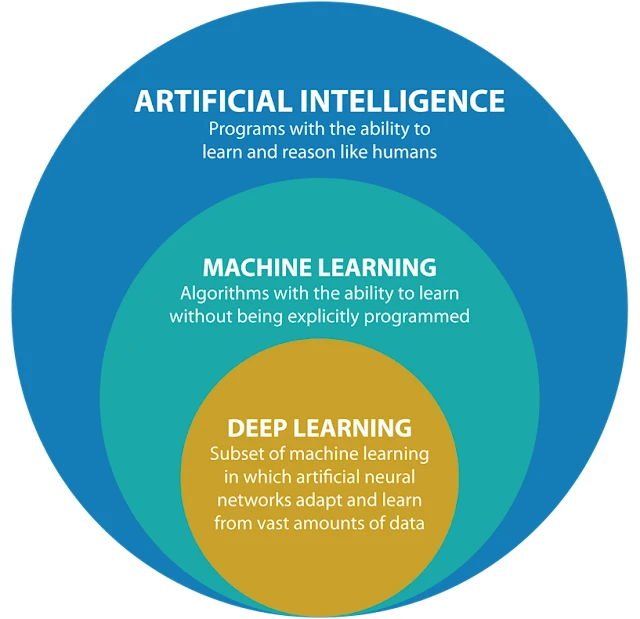

TentangAI.com – convolutional neural networks (CNN), recurrent neural networks (RNN), dan Transformer merupakan tiga algoritma deep learning yang paling sering digunakan dalam pengolahan data besar dan kompleks. CNN unggul dalam ekstraksi fitur visual dari data gambar berkat lapisan konvolusinya yang mampu menangkap pola spasial. RNN, khususnya varian Long Short-Term Memory (LSTM), dirancang untuk memproses data berurutan seperti teks dan suara dengan kemampuan mempertahankan konteks jangka panjang. Transformer, sebagai generasi baru, mengoptimalkan pemrosesan data sekuensial melalui mekanisme self-attention yang memungkinkan paralelisasi pelatihan dan peningkatan efisiensi, terutama di bidang natural language processing (NLP).

Convolutional Neural Networks (CNN) pertama kali dikembangkan oleh Yann LeCun pada akhir 1980-an dengan model LeNet untuk pengenalan karakter tulisan tangan. Arsitektur CNN terdiri dari lapisan konvolusi yang mengekstrak fitur lokal, lapisan pooling untuk mereduksi dimensi data, dan fungsi aktivasi non-linear seperti ReLU untuk menambah kompleksitas representasi. CNN sangat efektif dalam aplikasi computer vision seperti deteksi objek, segmentasi citra medis, dan pengenalan wajah. Studi kasus pada analisis sentimen pemilu menunjukkan CNN dapat mencapai akurasi validasi hingga 99%, mengungguli model lain dalam klasifikasi teks berbasis gambar.

Selain keunggulan dalam pengolahan gambar, CNN juga memiliki keterbatasan dalam mengelola data sekuensial dan temporal. Model ini kurang mampu menangkap hubungan konteks jangka panjang yang penting dalam analisis bahasa dan suara.

Recurrent Neural Networks (RNN) dan Variannya (LSTM)

RNN dirancang untuk menangani data berurutan dengan menyimpan informasi dari langkah sebelumnya yang digunakan untuk memprediksi langkah berikutnya. Namun, model RNN standar menghadapi masalah vanishing gradient yang membatasi kemampuannya dalam menangkap konteks jangka panjang. Long Short-Term Memory (LSTM), sebagai varian RNN, mengatasi masalah ini dengan struktur memori khusus yang mengontrol aliran informasi melalui gerbang input, output, dan forget.

RNN dan LSTM banyak digunakan dalam pemrosesan bahasa alami (NLP) seperti analisis sentimen, terjemahan mesin, dan speech recognition. Dalam konteks analisis sentimen pemilu, RNN mampu menangani data teks berurutan namun akurasinya umumnya lebih rendah, sekitar 77%, dibanding CNN yang lebih fokus pada fitur spasial. Kelebihan RNN terletak pada kemampuannya mengolah data sekuensial dengan konteks temporal, sedangkan kekurangannya adalah tingkat efisiensi yang lebih rendah dan kesulitan dalam pelatihan pada dataset besar.

Transformer: Algoritma Deep Learning Generasi Baru

Transformer memperkenalkan mekanisme self-attention yang memungkinkan model untuk fokus pada bagian data yang paling relevan tanpa memproses informasi secara berurutan seperti RNN. Arsitektur ini terdiri dari encoder dan decoder dengan lapisan multi-head attention yang meningkatkan kapasitas pemodelan konteks secara paralel. Keunggulan utama Transformer adalah efisiensi pelatihan yang jauh lebih tinggi dan kemampuan skala pada dataset besar.

Transformer telah merevolusi bidang NLP dengan aplikasi sukses seperti model BERT dan GPT yang mampu menghasilkan teks alami dan melakukan terjemahan mesin dengan akurasi tinggi. Selain NLP, Transformer juga mulai diaplikasikan dalam computer vision dengan arsitektur Vision Transformer (ViT) yang menyaingi performa CNN dalam klasifikasi gambar. Keunggulan Transformer dibanding RNN meliputi paralelisasi pelatihan yang lebih baik, kemampuan memproses konteks global secara lebih efektif, dan skalabilitas yang superior.

Algoritma Optimasi dalam Deep Learning

Stochastic Gradient Descent (SGD) merupakan algoritma optimasi klasik yang digunakan untuk memperbarui bobot jaringan saraf secara iteratif berdasarkan subset data (mini-batch). SGD dikenal karena efisiensi komputasi dan kesederhanaannya, namun membutuhkan penyesuaian parameter learning rate yang cermat untuk menghindari konvergensi lambat.

Adam Optimizer menggabungkan keunggulan momentum dan adaptive learning rate, sehingga mempercepat proses pelatihan dan meningkatkan stabilitas konvergensi. Adam secara otomatis menyesuaikan learning rate untuk setiap parameter, menjadikannya favorit dalam pelatihan model deep learning modern termasuk CNN, RNN, dan Transformer.

Backpropagation tetap menjadi mekanisme utama dalam pelatihan jaringan saraf, memungkinkan propagasi kesalahan dari output ke lapisan sebelumnya untuk memperbaiki bobot secara efisien. Kombinasi backpropagation dengan algoritma optimasi seperti SGD dan Adam memastikan model dapat belajar dari data dengan akurasi tinggi.

Metode Pendukung: Transfer Learning dan Federated Learning

Transfer Learning memungkinkan penggunaan model yang telah dilatih sebelumnya (pretrained) pada tugas baru dengan dataset yang lebih kecil. Teknik ini sangat efektif untuk mempercepat pelatihan dan meningkatkan performa model, terutama dalam aplikasi seperti pengenalan citra dan NLP di mana dataset besar sulit diperoleh.

Federated Learning merupakan pendekatan pelatihan model secara terdistribusi di beberapa perangkat atau server tanpa harus mengumpulkan data secara sentral. Metode ini meningkatkan privasi data sekaligus memungkinkan kolaborasi pelatihan model pada skala besar. Federated Learning cocok untuk aplikasi yang memerlukan keamanan data tinggi seperti dalam sektor kesehatan dan keuangan.

Perbandingan Kinerja dan Kelebihan-Manfaat Algoritma

| Algoritma | Kelebihan | Kelemahan | Aplikasi Utama |

|---|---|---|---|

| CNN | Ekstraksi fitur spasial, akurasi tinggi pada data gambar, efisien dalam pemrosesan citra | Kurang optimal untuk data sekuensial, sulit menangkap konteks temporal | Computer vision, deteksi objek, citra medis |

| RNN / LSTM | Mampu mengolah data sekuensial, mempertahankan konteks jangka panjang dengan LSTM | Pelatihan lebih lambat, risiko vanishing gradient pada RNN standar | Speech recognition, NLP, analisis sentimen |

| Transformer | Paralelisasi pelatihan, efisiensi tinggi, menangani konteks global, skalabilitas besar | Membutuhkan sumber daya komputasi besar, kompleksitas arsitektur tinggi | Terjemahan mesin, generasi teks, Vision Transformer untuk citra |

Dari segi akurasi dan efisiensi, CNN unggul pada pengolahan citra dengan kemampuan ekstraksi fitur yang kuat, sedangkan RNN dan LSTM lebih cocok untuk data berurutan dengan kebutuhan konteks temporal. Transformer mengambil posisi terdepan dalam pemrosesan bahasa alami karena kemampuan paralelisasi dan skala yang mampu mengatasi keterbatasan RNN. Namun, Transformer membutuhkan sumber daya komputasi yang lebih besar dibanding CNN dan RNN.

FAQ

Apa perbedaan utama antara CNN dan RNN dalam deep learning?

CNN fokus pada ekstraksi fitur spasial dari data gambar menggunakan lapisan konvolusi, sedangkan RNN dirancang untuk memproses data sekuensial dengan kemampuan mempertahankan konteks temporal. CNN lebih unggul di computer vision, sementara RNN ideal untuk pemrosesan bahasa dan suara.

Kenapa Transformer lebih efisien dibanding RNN dalam NLP?

Transformer menggunakan mekanisme self-attention yang memungkinkan pemrosesan paralel seluruh data sekuensial, berbeda dengan RNN yang memproses data secara berurutan. Hal ini meningkatkan kecepatan pelatihan dan kemampuan menangkap konteks global.

Bagaimana Transfer Learning membantu dalam pelatihan model deep learning?

Transfer Learning memanfaatkan model pretrained yang sudah belajar fitur umum pada dataset besar, sehingga mempercepat pelatihan dan meningkatkan akurasi pada tugas baru dengan dataset terbatas.

Apa keunggulan Adam Optimizer dibanding SGD?

Adam Optimizer mengadaptasi learning rate untuk setiap parameter secara otomatis dan menggabungkan momentum, sehingga mempercepat konvergensi dan membuat pelatihan lebih stabil dibanding SGD yang menggunakan learning rate tetap.

Dalam kondisi apa Federated Learning lebih diutamakan?

Federated Learning digunakan ketika data tersebar di banyak perangkat atau lokasi dengan kebutuhan privasi tinggi, seperti dalam aplikasi medis dan finansial, karena metode ini melatih model tanpa harus mengumpulkan data secara terpusat.

pengembangan algoritma deep learning seperti CNN, RNN, dan Transformer terus berlanjut seiring dengan kebutuhan aplikasi yang semakin kompleks. Di masa depan, integrasi metode seperti federated learning dan transfer learning akan semakin penting untuk mengatasi tantangan privasi dan keterbatasan data. Optimalisasi algoritma dan penggunaan sumber daya komputasi yang efisien juga menjadi fokus utama agar model deep learning dapat diterapkan secara luas di berbagai industri seperti kesehatan, otomotif, dan telekomunikasi dengan hasil yang akurat dan dapat diandalkan.