TentangAI.com – GPT dan model bahasa besar (Large Language Models/LLM) lainnya mengandalkan arsitektur transformer yang mengintegrasikan mekanisme self-attention untuk memahami konteks kalimat secara utuh. Dengan memproses input berupa token-token teks, model ini mampu memprediksi kata berikutnya secara akurat berdasarkan pola bahasa yang dipelajari dari dataset berukuran triliunan token. Misalnya, GPT-4 memiliki sekitar 100 triliun parameter yang memungkinkan pemodelan konteks sangat luas, sehingga menghasilkan teks yang menyerupai bahasa manusia secara natural. Teknologi ini tidak hanya mengandalkan jaringan neural biasa, tetapi mengoptimalkan artificial neural network (ANN) dengan lapisan-lapisan transformer yang memungkinkan paralelisasi dan efisiensi komputasi tinggi.

Pengantar Model Bahasa Besar (LLM) dan GPT

model bahasa besar (LLM) merupakan jenis model machine learning yang dilatih untuk memahami, memproses, dan menghasilkan bahasa alami dengan skala parameter sangat besar dan dataset yang luas. Awalnya, model-model NLP tradisional menggunakan pendekatan statistik atau RNN (Recurrent Neural Network) yang terbatas dalam mengelola konteks panjang. Kemunculan arsitektur transformer oleh Google pada 2017 merevolusi NLP dengan kemampuan self-attention yang memperhitungkan seluruh konteks input secara paralel. GPT (generative pre-trained transformer) merupakan salah satu implementasi LLM terkemuka yang dikembangkan oleh OpenAI sejak 2018, berfokus pada kemampuan generatif teks melalui pra-pelatihan besar-besaran dan fine-tuning.

GPT berperan sebagai model prediktif bahasa yang mampu menghasilkan teks koheren dan relevan dalam berbagai konteks. Versi terbaru seperti GPT-4 memperluas kapasitas parameter hingga ratusan triliun, memungkinkan pemahaman konteks lebih baik dan kemampuan lintas domain, mulai dari percakapan sehari-hari hingga penulisan kode program.

Arsitektur Transformer: Fondasi Kecerdasan Bahasa Besar

arsitektur transformer terdiri dari dua modul utama: encoder dan decoder. Namun, GPT menggunakan varian decoder-only yang fokus pada prediksi token selanjutnya berdasarkan input sebelumnya. Modul self-attention menjadi inti dari transformer, berfungsi untuk menilai relevansi setiap token terhadap token lain dalam satu urutan. Mekanisme ini memungkinkan model mengelola konteks sepanjang kalimat atau paragraf secara bersamaan, berbeda dengan model lama yang hanya memproses urutan token secara berurutan.

Self-attention bekerja dengan cara menghitung bobot hubungan antar token menggunakan query, key, dan value vectors yang dihasilkan dari embedding token. Hal ini menghasilkan representasi konteks yang kaya dan adaptif sesuai dengan informasi yang diproses. Misalnya, dalam kalimat “Dia pergi ke bank untuk menarik uang,” model dapat membedakan arti “bank” sebagai institusi finansial berdasarkan konteks kalimat, berkat kemampuan self-attention.

Proses Pelatihan GPT dan Model Bahasa Besar Lainnya

Pelatihan GPT terdiri dari dua tahap utama: pra-pelatihan (pre-training) dan penyempurnaan (fine-tuning). Pra-pelatihan dilakukan dengan menggunakan dataset teks sangat besar yang mencakup buku, artikel, situs web, dan korpus lainnya yang berjumlah triliunan token. Tujuannya adalah mengajarkan model pola bahasa secara umum, termasuk sintaksis, semantik, dan hubungan kontekstual antar kata.

Parameter model, yang bisa mencapai ratusan miliar hingga triliunan, berfungsi sebagai bobot dalam jaringan neural yang secara bertahap dioptimalkan menggunakan algoritme pembelajaran terawasi (supervised learning) dan teknik optimasi seperti Adam. Parameter ini memungkinkan model mengenali pola kompleks dalam bahasa dan memprediksi token selanjutnya dengan probabilitas tinggi.

Setelah pra-pelatihan, model dapat menjalani fine-tuning di domain spesifik untuk meningkatkan performa di aplikasi tertentu, seperti chatbot kesehatan atau asisten pemrograman. Fine-tuning menggunakan dataset lebih kecil yang relevan untuk konteks tersebut, sehingga model mampu menyesuaikan outputnya dengan kebutuhan spesifik pengguna.

Cara Kerja GPT dalam Memproses Input dan Menghasilkan Output

Proses kerja GPT dimulai dengan tokenisasi, yaitu memecah teks input menjadi unit-unit kecil yang disebut token. Token bisa berupa kata, bagian kata, atau karakter tergantung metode tokenisasi yang digunakan, seperti Byte Pair Encoding (BPE). Tokenisasi memungkinkan model menganalisis dan memproses teks dalam format numerik yang bisa dimengerti oleh jaringan neural.

Setelah tokenisasi, GPT menerapkan self-attention untuk menghitung hubungan antar token dalam konteks input. Model kemudian memprediksi token berikutnya dengan mengestimasi probabilitas setiap token yang mungkin muncul. Token dengan probabilitas tertinggi dipilih sebagai output. Proses ini berulang hingga mencapai batas token yang ditentukan atau tanda akhir kalimat.

Misalnya, jika input berupa “Cuaca hari ini sangat”, model akan memproses token-token tersebut dan memprediksi kemungkinan kata berikutnya seperti “panas”, “dingin”, atau “cerah” berdasarkan konteks dan pola bahasa yang telah dipelajari.

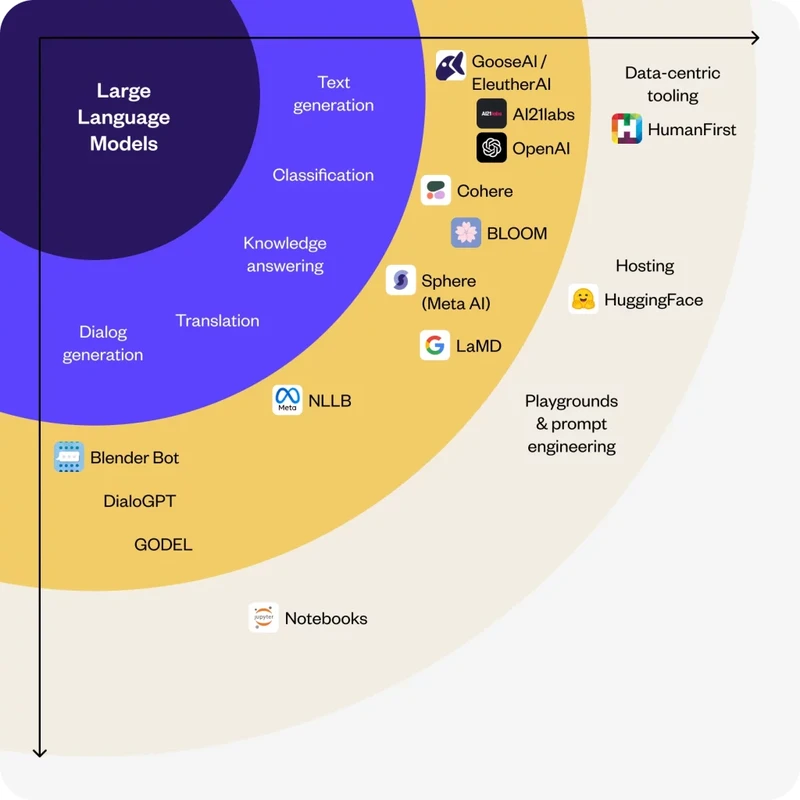

Perbandingan dengan Model Bahasa Besar Lain

Selain GPT, model bahasa besar populer lainnya meliputi Meta LLaMA, Anthropic Claude, Google Gemini, Mistral AI, dan Falcon. Masing-masing memiliki keunggulan dan fokus yang berbeda. LLaMA dari Meta misalnya, mengusung pendekatan lebih efisien dengan parameter lebih sedikit namun performa kompetitif dalam NLP. Anthropic Claude menekankan aspek keamanan dan etika AI dalam desainnya.

Google Gemini dan Google Transformer merupakan evolusi dari riset Google yang terus meningkatkan kemampuan self-attention dan integrasi multimodal (teks, gambar). Mistral AI dan Falcon dikenal sebagai model open-source yang memberikan fleksibilitas pengembangan bagi komunitas riset.

Perbandingan utama terletak pada jumlah parameter, dataset pelatihan, dan tujuan aplikasi. GPT-4 unggul dalam kematangan teknologi dan dukungan ekosistem luas, sementara model lain menonjol dalam efisiensi, keterbukaan, atau fokus domain spesifik.

| Model | Jumlah Parameter | Fokus Utama | Keunggulan | Penggunaan Utama |

|---|---|---|---|---|

| GPT-4 (OpenAI) | ~100 triliun | Generatif teks dan multi-domain | Kemampuan bahasa alami canggih, ekosistem API luas | Chatbot, penulisan kode, AI kreatif |

| Meta LLaMA | 7 miliar – 65 miliar | Efisiensi dan riset NLP | Model ringan dengan performa tinggi | Riset, aplikasi NLP umum |

| Anthropic Claude | Belum dipublikasikan | Keamanan dan etika AI | Fokus pada penggunaan aman dan etis | Asisten virtual, layanan pelanggan |

| Google Gemini | Sekitar 20-50 miliar | Multimodal dan NLP | Integrasi teks dan gambar | AI percakapan, analisis data multimodal |

| Mistral AI | 12 miliar | Open-source dan efisiensi | Kustomisasi dan pengembangan komunitas | Pengembangan AI open-source |

Implementasi dan Aplikasi GPT dalam Berbagai Industri

GPT dan LLM lain telah meluas penggunaannya di berbagai sektor. Dalam industri layanan pelanggan, ChatGPT digunakan sebagai chatbot yang mampu merespons pertanyaan secara natural dan kontekstual, mengurangi kebutuhan intervensi manusia. Dalam pengembangan perangkat lunak, GPT digunakan untuk menulis kode, debugging, dan dokumentasi otomatis, meningkatkan produktivitas developer.

Di bidang terjemahan bahasa, LLM mampu memberikan hasil terjemahan yang lebih kontekstual dibandingkan alat tradisional. Selain itu, LLM digunakan dalam pembuatan konten kreatif, pengembangan game, hingga analisis data teks dalam riset pasar.

Contoh studi kasus penggunaan GPT-4 termasuk asisten virtual yang mampu memahami konteks percakapan panjang dan memberikan rekomendasi produk atau solusi teknis yang tepat, serta integrasi dalam platform pembelajaran untuk memberikan penjelasan konsep secara interaktif.

Tantangan dan Kebutuhan Infrastruktur untuk Model Besar

Pelatihan dan pengoperasian model bahasa besar memerlukan sumber daya komputasi luar biasa besar, seperti GPU/TPU berkapasitas tinggi dan cluster komputasi awan. Misalnya, pelatihan GPT-4 diperkirakan menggunakan ribuan GPU selama berminggu-minggu dengan konsumsi listrik yang signifikan.

Penggunaan model besar pada perangkat keras standar seperti laptop masih terbatas karena kebutuhan memori dan kecepatan komputasi tinggi. Solusi cloud computing seperti Amazon Bedrock menyediakan API yang memungkinkan integrasi LLM tanpa perlu infrastruktur lokal yang mahal.

Selain kebutuhan hardware, tantangan lain meliputi manajemen data besar, keamanan, dan etika penggunaan AI, terutama untuk menghindari bias dan penyalahgunaan teknologi.

Lisensi dan Penggunaan Komersial Model Bahasa Besar

Lisensi model bahasa besar bervariasi dari open-source hingga proprietary. Model open-source seperti Mistral AI dan LLaMA memungkinkan peneliti dan pengembang mengakses model dengan lisensi yang mendukung modifikasi dan distribusi. Sebaliknya, model proprietary seperti GPT-4 memiliki lisensi komersial yang diatur oleh OpenAI dengan akses melalui API berbayar.

Platform seperti Amazon Bedrock menawarkan layanan API untuk berbagai model LLM, memungkinkan perusahaan mengintegrasikan AI generatif ke dalam aplikasi tanpa mengelola model secara langsung. Hal ini mempercepat adopsi AI dalam bisnis dengan skala dan biaya yang lebih terkendali.

Pertimbangan lisensi juga mencakup aspek privasi data, kepatuhan regulasi, dan batasan penggunaan untuk menghindari pelanggaran hak cipta atau penyebaran informasi palsu.

Masa Depan Model Bahasa Besar dan AI Generatif

Tren perkembangan model bahasa besar mengarah pada peningkatan jumlah parameter, efisiensi komputasi, dan kemampuan multimodal yang menggabungkan teks, gambar, suara, dan data sensorik lain. Model masa depan diprediksi mampu memahami konteks lebih dalam, melakukan reasoning kompleks, dan berinteraksi secara lebih natural.

Dampak teknologi ini akan memperluas interaksi manusia dengan mesin, membuka peluang inovasi di bidang pendidikan, kesehatan, hiburan, dan riset ilmiah. Namun, pengembangan juga harus diimbangi dengan penerapan etika AI untuk menghindari risiko penyalahgunaan dan bias algoritmik.

Langkah praktis bagi pengembang dan bisnis adalah memanfaatkan API LLM yang tersedia untuk prototyping dan integrasi, sekaligus mengikuti perkembangan riset untuk memahami batasan dan potensi teknologi ini.

FAQ

Apa itu GPT dan bagaimana cara kerjanya?

GPT adalah model bahasa besar yang menggunakan arsitektur transformer dengan mekanisme self-attention untuk memahami konteks teks secara menyeluruh. Model ini dilatih pada dataset teks besar untuk memprediksi token berikutnya, sehingga mampu menghasilkan teks yang menyerupai bahasa manusia.

Bagaimana proses pelatihan GPT dilakukan?

Pelatihan GPT terdiri dari pra-pelatihan menggunakan dataset teks sangat besar untuk mempelajari pola bahasa secara umum, kemudian dilakukan fine-tuning di domain spesifik untuk meningkatkan performa aplikasi tertentu.

Apa perbedaan utama GPT dengan model LLM lain seperti LLaMA atau Claude?

Perbedaan utama terletak pada jumlah parameter, fokus aplikasi, dan kebijakan lisensi. GPT cenderung memiliki parameter lebih besar dan ekosistem API yang matang, sedangkan LLaMA dan Claude menawarkan efisiensi atau fokus pada aspek keamanan dan etika AI.

Apa tantangan terbesar dalam penggunaan model bahasa besar?

Tantangan utama adalah kebutuhan sumber daya komputasi yang sangat besar, pengelolaan data besar, serta isu etika dan keamanan, termasuk potensi bias dan penyalahgunaan model.

Bagaimana cara menggunakan GPT untuk aplikasi bisnis?

Bisnis dapat menggunakan layanan API seperti Amazon Bedrock atau OpenAI API untuk mengintegrasikan GPT ke dalam aplikasi chatbot, otomatisasi penulisan, analisis data, dan layanan AI lainnya tanpa harus membangun infrastruktur pelatihan sendiri.