TentangAI.com – Bias dalam kecerdasan buatan (AI) muncul ketika hasil algoritma tidak adil atau diskriminatif terhadap kelompok tertentu, yang sering kali disebabkan oleh data pelatihan yang tidak representatif atau proses pengembangan algoritma yang kurang transparan. Dampak bias AI dapat sangat luas, mulai dari keputusan perekrutan yang merugikan kandidat tertentu, penilaian risiko kredit yang tidak akurat, hingga diskriminasi dalam layanan kesehatan. Studi IBM menunjukkan bahwa hingga 20% model AI yang digunakan di sektor keuangan dan perekrutan mengandung bias signifikan yang berpotensi merugikan kelompok minoritas.

Ketidakseimbangan data pelatihan menjadi sumber utama bias AI, di mana data yang kurang beragam atau tidak inklusif mencerminkan realitas yang tidak lengkap. Variabel proxy yang tidak tepat dalam algoritma juga dapat memperkuat bias tersebut. Selain itu, kurangnya transparansi selama proses pengembangan membuat sulit untuk mengidentifikasi dan mengatasi bias secara efektif. Faktor manusia, termasuk bias pengembang dan pemilihan data yang tidak disadari, juga berkontribusi pada masalah ini.

Pengertian Bias dalam AI dan Dampaknya

bias AI adalah ketidakseimbangan yang muncul dari model yang memberikan hasil berbeda secara sistematis terhadap kelompok tertentu berdasarkan atribut seperti ras, gender, atau usia. Contohnya, sistem perekrutan otomatis yang menolak pelamar perempuan atau sistem kredit yang lebih sering menolak aplikasi dari wilayah tertentu. Di sektor keuangan, bias ini dapat menyebabkan ketidakadilan dalam penilaian risiko pinjaman, sementara di bidang kesehatan, diagnosis penyakit berbasis AI dapat kurang akurat untuk etnis tertentu jika data pelatihan tidak memadai.

Studi terbaru dari MIT mengungkap bahwa model AI dalam perekrutan yang tidak diaudit secara rutin dapat memperkuat stereotip gender dan ras, yang berdampak buruk pada keragaman tenaga kerja. Sektor kesehatan juga mengalami tantangan serupa, di mana algoritma yang tidak mempertimbangkan keragaman populasi menghasilkan rekomendasi pengobatan yang kurang efektif bagi kelompok minoritas.

Penyebab Bias AI

Penyebab utama bias AI adalah ketidakseimbangan data pelatihan yang tidak mencakup keragaman populasi secara menyeluruh. Teknik oversampling dan undersampling sering digunakan untuk menyesuaikan distribusi data agar lebih representatif, misalnya dengan memperbanyak sampel dari kelompok minoritas (oversampling) atau mengurangi sampel dari kelompok mayoritas (undersampling). Namun, teknik ini harus diterapkan dengan hati-hati agar tidak menimbulkan overfitting atau distorsi data.

Kurangnya transparansi algoritma juga mempersulit pendeteksian bias. Algoritma black-box yang kompleks tidak memungkinkan pengembang atau auditor memahami bagaimana keputusan dibuat. Hal ini mendorong kebutuhan teknologi explainable AI (XAI) yang memungkinkan interpretasi model secara lebih jelas. Faktor manusia, seperti asumsi yang tidak disadari dalam pemilihan fitur atau data, juga berperan penting dalam memperkenalkan bias.

Strategi Menghindari Bias dalam Penggunaan AI

Penggunaan prompt yang spesifik dan bebas dari asumsi dapat membantu mengurangi bias dalam model AI berbasis bahasa atau sistem rekomendasi. Misalnya, dalam pengembangan Gemini AI, prompt yang dirancang secara hati-hati menghindari pertanyaan yang memicu stereotip atau diskriminasi.

Memilih dan melatih model AI dengan data pelatihan yang inklusif dan representatif adalah langkah fundamental. Data harus mencakup keragaman etnis, gender, usia, dan variabel relevan lainnya sesuai konteks aplikasi. Teknik oversampling dan undersampling secara cermat diterapkan untuk memperbaiki distribusi data yang timpang.

Adversarial training juga menjadi strategi penting, di mana model diuji dengan data yang dirancang untuk mengekspos kelemahan bias, sehingga algoritma dapat diperkuat agar lebih adil. Pendekatan ini telah diadopsi oleh beberapa perusahaan teknologi besar untuk meningkatkan fairness model mereka.

Peran Transparansi dan Audit dalam Mengurangi Bias

Audit bias AI dilakukan secara pra dan pasca penerapan untuk mendeteksi potensi ketidakadilan algoritma. Audit ini melibatkan pengujian bias statistik, analisis fairness, dan evaluasi dampak sosial dari model. Penggunaan teknologi explainability (XAI) seperti LIME atau SHAP membantu menjelaskan keputusan model secara transparan, sehingga auditor dan pemangku kepentingan dapat memahami alasan di balik output AI.

Pelibatan auditor independen dan dewan etika AI menjadi praktik terbaik untuk memastikan objektivitas dan akuntabilitas. Perusahaan seperti IBM dan lembaga audit independen telah mengembangkan standar audit bias yang digunakan secara internasional. Audit berkala juga mendukung deteksi bias yang mungkin muncul seiring waktu akibat perubahan data atau konteks.

Tata Kelola dan Akuntabilitas AI

Implementasi tata kelola AI berbasis prinsip Diversity, Equity, and Inclusion (DEI) menjadi kerangka kerja penting untuk mitigasi bias jangka panjang. Hal ini melibatkan penunjukan tim pengawas yang terdiri dari ahli multidisiplin termasuk etika, hukum, dan teknologi, serta pembentukan komite etik AI yang bertugas memantau dan mengevaluasi kebijakan penggunaan AI.

Pemantauan berkelanjutan diperlukan untuk mengidentifikasi perubahan bias yang mungkin terjadi akibat pembaruan data atau algoritma. Sistem pelaporan dan mekanisme tanggung jawab yang jelas harus ada untuk memastikan setiap keputusan AI dapat dipertanggungjawabkan. Tata kelola yang baik juga mendukung kepatuhan terhadap regulasi dan standar internasional yang semakin ketat terkait etika AI.

Human-in-the-Loop dan Teknologi Pendukung

Mekanisme human-in-the-loop menempatkan manusia sebagai pengawas dan pengambil keputusan akhir dalam proses AI, khususnya pada kasus-kasus yang berpotensi kontroversial atau berdampak besar. Hal ini meningkatkan akurasi dan fairness keputusan, sekaligus memberikan kesempatan intervensi apabila model menunjukkan bias.

Penggunaan perangkat AI fairness tools seperti IBM AI Fairness 360 menyediakan toolkit untuk mengukur dan mengurangi bias secara otomatis. Tools ini mendukung pengembang dalam menguji berbagai metrik fairness dan menerapkan teknik mitigasi sesuai kebutuhan. Integrasi human-in-the-loop dengan teknologi explainability membuka peluang kolaborasi efektif antara manusia dan mesin dalam pengambilan keputusan yang adil.

Pendidikan dan Literasi AI untuk Pengguna dan Pengembang

Program pelatihan dan literasi AI sangat krusial untuk meningkatkan kesadaran tentang potensi bias dan etika dalam pengembangan AI. Literasi AI mencakup pemahaman tentang data yang digunakan, algoritma yang diterapkan, serta risiko dan konsekuensi sosial dari teknologi AI.

Perusahaan dan organisasi perlu menerapkan program pelatihan rutin bagi pengembang dan pengguna AI, termasuk pelajaran tentang teknik mitigasi bias, audit algoritma, dan tata kelola DEI. Literasi AI yang baik juga mendukung pengambilan keputusan yang lebih bijaksana dan transparan oleh pengguna akhir.

Studi Kasus dan Implementasi Praktis

Di sektor keuangan, sebuah bank besar menerapkan audit bias rutin dan teknik oversampling untuk mengurangi diskriminasi dalam penilaian kredit. Bank tersebut juga menggunakan teknologi explainability untuk menjelaskan hasil keputusan kredit kepada nasabah, meningkatkan kepercayaan dan kepatuhan regulasi.

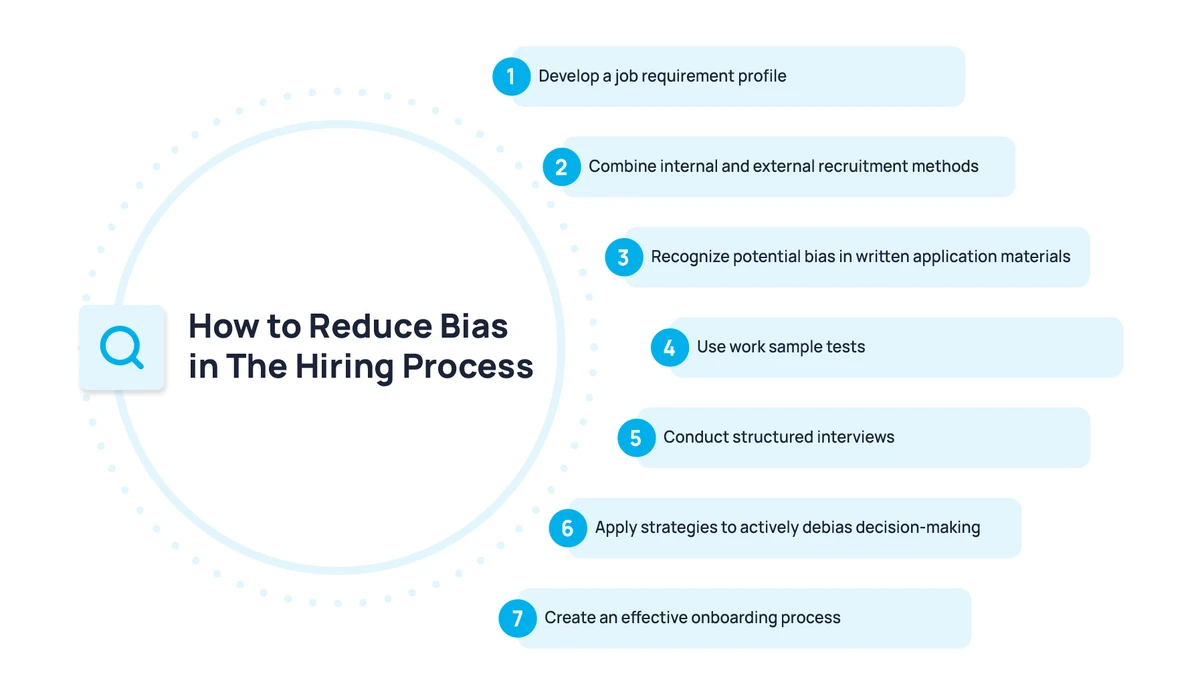

Dalam perekrutan, perusahaan teknologi menggunakan pendekatan ‘Intelligent Analysis’ yang mengkombinasikan human-in-the-loop dengan audit algoritma untuk memastikan proses seleksi yang adil dan inklusif. Teknik adversarial training digunakan untuk menguji model dengan data yang menantang asumsi bias, sehingga model dapat diperbaiki sebelum diterapkan secara luas.

| Aspek | Pendekatan | Manfaat | Contoh Implementasi |

|---|---|---|---|

| Data Pelatihan | Oversampling/Undersampling, Data inklusif | Perbaikan representasi, pengurangan bias | Bank keuangan menggunakan oversampling untuk kelompok minoritas |

| Audit dan Transparansi | Audit bias rutin, Explainable AI (XAI) | Mendeteksi dan menjelaskan bias, meningkatkan kepercayaan | IBM AI Fairness 360 dan dewan etik independen |

| Tata Kelola AI | Kerangka DEI, Komite etik, Pemantauan berkelanjutan | Akuntabilitas, kepatuhan regulasi, mitigasi jangka panjang | Perusahaan teknologi membentuk komite etik AI internal |

| Human-in-the-Loop | Pengawasan manusia dalam keputusan AI | Verifikasi keputusan, pengambilan keputusan adil | Proses seleksi perekrutan menggunakan human-in-the-loop |

FAQ

Apa penyebab utama bias dalam AI?

Penyebab utama bias AI adalah ketidakseimbangan dan kurangnya keragaman data pelatihan, kurangnya transparansi algoritma, serta pengaruh bias manusia dalam pengembangan dan pemilihan data.

Bagaimana teknik oversampling dan undersampling membantu mengurangi bias?

Teknik oversampling memperbanyak data dari kelompok minoritas agar representasi lebih seimbang, sementara undersampling mengurangi data dari kelompok mayoritas. Kedua teknik ini membantu memperbaiki distribusi data sehingga model AI lebih adil.

Apa peran explainable AI (XAI) dalam mitigasi bias?

XAI memungkinkan interpretasi dan penjelasan keputusan model AI secara transparan, membantu auditor dan pengembang memahami bagaimana hasil dibuat dan mendeteksi potensi bias.

Kenapa human-in-the-loop penting dalam pengambilan keputusan AI?

Human-in-the-loop memberikan lapisan verifikasi manusia dalam proses pengambilan keputusan AI, mencegah kesalahan atau bias yang tidak terdeteksi oleh mesin dan memastikan hasil yang lebih adil.

Bagaimana tata kelola DEI mendukung mitigasi bias AI?

Tata kelola DEI melibatkan kerangka kerja inklusif yang mendorong keragaman, keadilan, dan inklusi dalam pengembangan dan penggunaan AI, melalui tim pengawas, komite etik, dan pemantauan berkelanjutan.

—

Ke depan, pengembangan AI yang adil dan akurat menuntut perpaduan teknik teknis seperti adversarial training dan oversampling dengan tata kelola yang ketat serta pengawasan manusia yang konsisten. Peningkatan literasi AI pada pengguna dan pengembang akan menjadi kunci untuk memperkuat akuntabilitas dan transparansi, sekaligus mendorong inovasi AI yang bertanggung jawab. Integrasi teknologi explainability dan human-in-the-loop harus terus dikembangkan agar AI tidak hanya cerdas secara teknis, namun juga adil secara sosial dan etis.