TentangAI.com – Kecerdasan Buatan (AI) memproses data secara efektif melalui rangkaian tahapan yang dimulai dari pengumpulan data berkualitas tinggi, dilanjutkan dengan pra-pemrosesan untuk membersihkan dan mengubah data agar sesuai dengan kebutuhan model, serta penggunaan algoritma canggih seperti jaringan saraf tiruan untuk melatih model mengenali pola dan melakukan prediksi dengan akurasi tinggi. Teknik seperti natural language processing (NLP) dan Computer Vision memungkinkan AI untuk memahami bahasa manusia dan menginterpretasi gambar atau video, sehingga memperluas cakupan aplikasi AI dalam berbagai bidang.

Kualitas dataset menjadi fondasi utama keberhasilan AI dalam pengolahan data. Data yang representatif dan beragam mencakup format teks, gambar, suara, hingga data numerik yang memberikan konteks lebih lengkap bagi model. Pengumpulan data ini harus dilakukan dengan ketat agar memenuhi standar kualitas dan relevansi, karena data yang buruk atau bias dapat menyebabkan hasil prediksi yang tidak akurat dan berpotensi menimbulkan risiko etis.

Pengumpulan Data: Fondasi Kualitas AI

Dataset yang digunakan dalam AI harus memiliki kualitas tinggi, representatif, dan mencakup variasi yang memadai agar model dapat belajar mengenali pola secara komprehensif. Misalnya, dalam pengenalan wajah menggunakan computer vision, dataset harus memuat gambar dari berbagai sudut, pencahayaan, dan kondisi wajah yang berbeda. Selain itu, keanekaragaman data juga mengurangi risiko bias yang dapat merugikan kelompok tertentu.

Jenis data yang umum diproses AI meliputi teks, gambar, suara, dan data numerik. Teks digunakan dalam aplikasi NLP untuk analisis sentimen, penerjemahan bahasa, atau chatbot. Gambar dan video diolah melalui computer vision untuk pengenalan objek, deteksi anomali, dan automasi inspeksi kualitas. Data suara memungkinkan pengembangan asisten virtual dan sistem pengenalan suara. Data numerik atau big data menjadi bahan analisis prediktif di bidang keuangan, kesehatan, dan pemasaran.

Tahap Pra-pemrosesan Data

pra-pemrosesan data adalah tahap kritis yang bertujuan membersihkan, menyelaraskan, dan mengubah format data agar sesuai dengan kebutuhan model AI. pembersihan data mencakup penghilangan duplikasi, penanganan missing values, dan identifikasi outliers yang bisa mengganggu proses pelatihan. Misalnya, data sensor yang hilang pada monitoring industri harus diisi atau dikeluarkan agar model tidak menghasilkan prediksi yang keliru.

Normalisasi data adalah teknik yang mengubah skala data agar memiliki rentang yang konsisten, membantu model mempelajari pola tanpa bias akibat perbedaan skala. Transformasi data juga meliputi encoding fitur kategorikal menjadi format numerik yang dapat diproses oleh algoritma.

Alat modern seperti TensorFlow Data Validation (TFDV), Pandas Profiling, dan fitur AutoML dari Google Cloud menyediakan fungsi otomatis untuk pra-pemrosesan data, mengurangi kesalahan manusia dan mempercepat pipeline pengolahan data.

Pemilihan Model dan Arsitektur AI

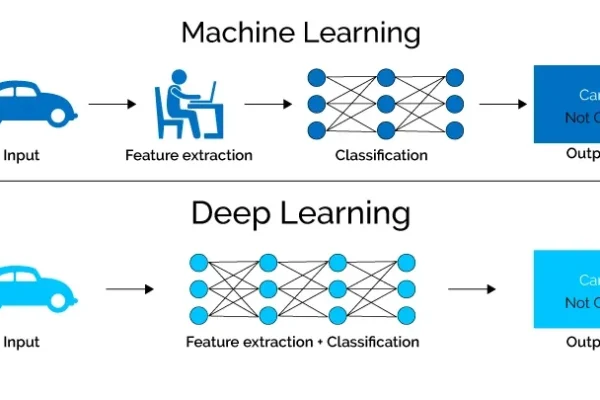

Model AI beragam jenisnya, mulai dari algoritma sederhana seperti regresi linier dan pohon keputusan hingga model kompleks seperti jaringan saraf tiruan dan deep learning. Pemilihan model harus disesuaikan dengan jenis data dan masalah yang ingin diselesaikan.

Jaringan saraf tiruan (Neural Networks) sangat efektif dalam mengenali pola non-linear dan kompleks, terutama pada data gambar dan suara. Deep learning, yang merupakan pengembangan dari neural networks dengan banyak lapisan tersembunyi, mampu melakukan ekstraksi fitur otomatis tanpa perlu intervensi manusia.

Di sisi lain, pohon keputusan dan algoritma ensemble seperti Random Forest dapat digunakan untuk data tabular dengan interpretasi model yang lebih mudah. Regresi cocok untuk prediksi nilai kontinu, seperti harga atau suhu.

Pelatihan Model AI dan Infrastruktur Komputasi

Pelatihan model AI memerlukan dataset besar yang diekspos secara berulang agar model dapat menggeneralisasi pola dengan baik. Proses ini menuntut daya komputasi tinggi, terutama untuk model deep learning yang melibatkan jutaan parameter.

Infrastruktur komputasi seperti GPU (Graphics Processing Unit) dan TPU (Tensor Processing Unit) sangat penting untuk mempercepat pelatihan model. Cloud computing dari penyedia seperti AWS, Google Cloud, dan Microsoft Azure menawarkan solusi skalabel yang memungkinkan pelatihan model secara efisien tanpa investasi hardware besar.

Tantangan teknis meliputi manajemen sumber daya komputasi, pengaturan hyperparameter, dan mitigasi overfitting agar model tidak hanya menghapal data pelatihan tetapi mampu beradaptasi dengan data baru.

Teknik Interpretasi Data oleh AI

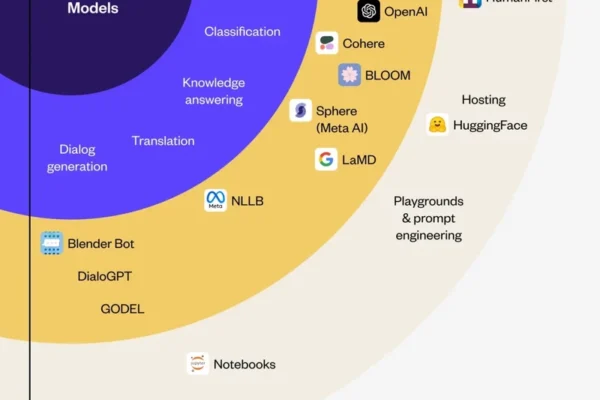

Natural Language Processing (NLP) memungkinkan AI memahami, mengolah, dan menghasilkan bahasa manusia secara alami. Contohnya termasuk analisis sentimen, ekstraksi informasi, dan penerjemahan otomatis yang sudah diterapkan secara luas di platform seperti Google Translate dan chatbot.

Computer Vision memungkinkan AI mengenali dan menginterpretasi gambar maupun video. Teknik seperti convolutional neural networks (CNN) digunakan untuk deteksi objek, klasifikasi gambar, dan segmentasi citra. Aplikasi praktisnya terlihat pada sistem pengawasan keamanan dan diagnosis medis berbasis citra.

Pemrosesan Dokumen Cerdas (Intelligent Document Processing/IDP) menggabungkan NLP dan computer vision untuk mengekstrak informasi dari dokumen tidak terstruktur seperti faktur, laporan, dan email secara otomatis, meningkatkan efisiensi operasional bisnis.

Peran AI dalam Analisis Data dan Pengambilan Keputusan

AI dapat mengotomatisasi tugas-tugas berulang seperti pengolahan data, validasi, dan pelaporan, yang secara signifikan mengurangi waktu dan biaya operasional. Misalnya, dalam sektor keuangan, AI membantu deteksi penipuan secara real-time dengan menganalisis pola transaksi.

Prediksi berbasis data historis memungkinkan perusahaan membuat keputusan yang lebih tepat. Studi kasus dari UNDP menunjukkan bagaimana AI digunakan untuk memprediksi kebutuhan logistik dalam bencana alam, meningkatkan respons dan mitigasi risiko.

Rekomendasi real-time berbasis AI juga diterapkan dalam e-commerce untuk meningkatkan pengalaman pelanggan dan penjualan dengan menganalisis perilaku pengguna secara dinamis.

Tantangan dan Risiko dalam Pengolahan Data AI

Keterbatasan utama dalam pengolahan data AI adalah kebutuhan dataset besar dan berkualitas. Data yang tidak memadai dapat menghasilkan model yang tidak akurat atau bias. Pengumpulan data yang berlebihan juga menimbulkan risiko privasi, terutama jika data mengandung informasi sensitif.

Pengawasan data dan transparansi algoritma menjadi isu penting dalam etika AI. Model AI yang tidak dapat dijelaskan (black-box) menimbulkan kekhawatiran terkait keputusan otomatis yang mempengaruhi kehidupan manusia, seperti dalam sistem kredit atau rekrutmen.

Perlindungan data pengguna dan kepatuhan pada regulasi seperti GDPR menjadi keharusan agar AI tidak disalahgunakan dan memenuhi standar etika.

| Aspek | Manfaat AI | Tantangan & Risiko | Solusi / Pendekatan |

|---|---|---|---|

| Pengumpulan Data | Data representatif meningkatkan akurasi model | Bias data, pelanggaran privasi | Audit data, anonymisasi data |

| Pra-pemrosesan | Meningkatkan kualitas input model | Kesalahan pembersihan, kehilangan informasi penting | Automasi dengan validasi manual |

| Pelatihan Model | Model mampu generalisasi pola kompleks | Kebutuhan komputasi besar, overfitting | Optimasi hyperparameter, regularisasi |

| Interpretasi Data | AI memahami bahasa dan citra secara efektif | Kesalahan interpretasi, ketergantungan model | Pengujian berulang, human-in-the-loop |

FAQ

Bagaimana AI mengenali pola dalam data?

AI mengenali pola melalui pelatihan model menggunakan dataset besar, di mana algoritma seperti jaringan saraf tiruan mempelajari hubungan kompleks antar data untuk menggeneralisasi pola yang bisa diterapkan pada data baru.

Apa peran pra-pemrosesan data dalam AI?

Pra-pemrosesan data membersihkan dan mengubah data agar sesuai format yang dibutuhkan model AI, termasuk penghilangan duplikasi, penanganan data hilang, serta normalisasi, sehingga meningkatkan akurasi dan efisiensi pelatihan model.

Bagaimana NLP dan computer vision membantu AI dalam pemrosesan data?

NLP membantu AI memahami dan menghasilkan bahasa manusia, sementara computer vision memungkinkan interpretasi gambar dan video. Kedua teknik ini memperluas aplikasi AI dalam analisis teks, pengenalan objek, dan automasi dokumen.

Apa saja tantangan utama dalam pelatihan model AI?

Tantangan utama meliputi kebutuhan komputasi yang besar, risiko overfitting, serta pengelolaan hyperparameter. Infrastruktur yang kuat dan teknik optimasi diperlukan untuk menghasilkan model yang efektif dan efisien.

Bagaimana AI mempengaruhi pengambilan keputusan di bisnis?

AI mengotomatisasi analisis data besar dan menyediakan prediksi serta rekomendasi real-time, yang membantu bisnis membuat keputusan lebih cepat dan tepat, meningkatkan efisiensi serta daya saing di pasar.

Pemahaman mendalam tentang proses pemrosesan data AI dari pengumpulan hingga pelatihan dan aplikasi praktisnya membuka peluang pengembangan sistem yang lebih canggih dan bertanggung jawab. Ke depan, peningkatan dataset berkualitas, teknik interpretasi yang lebih presisi, dan kesadaran etis akan menjadi kunci utama untuk memaksimalkan potensi AI dalam berbagai sektor kehidupan dan industri.