TentangAI.com – pemrosesan bahasa alami (Natural Language Processing – NLP) memungkinkan komputer memahami dan mengolah bahasa manusia melalui teknik seperti tokenisasi, stemming, lemmatization, dan model pembelajaran mesin. Tutorial ini akan memandu Anda langkah demi langkah memulai NLP menggunakan Python dan pustaka populer seperti spaCy dan NLTK, sehingga Anda dapat membuat aplikasi sederhana untuk analisis teks.

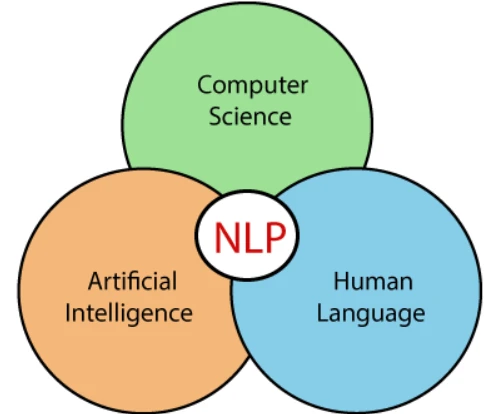

Apa itu Pemrosesan Bahasa Alami (NLP)?

Pemrosesan Bahasa Alami adalah cabang kecerdasan buatan yang menggabungkan ilmu komputer, linguistik, dan machine learning untuk memungkinkan komputer memahami, menganalisis, dan menghasilkan bahasa manusia secara otomatis. NLP digunakan di berbagai aplikasi seperti chatbot, analisis sentimen, ekstraksi informasi, dan penerjemahan otomatis.

Ruang lingkup NLP meliputi berbagai teknik mulai dari preprocessing data teks, pemodelan bahasa, hingga pemahaman konteks dan makna. Dengan meningkatnya volume data teks di internet, NLP menjadi sangat penting untuk mengubah data tidak terstruktur menjadi informasi yang dapat dimanfaatkan.

Prasyarat untuk Memulai NLP

Sebelum memulai, pastikan Anda memahami dasar-dasar berikut:

Python adalah bahasa utama dalam NLP. Anda harus familiar dengan variabel, tipe data, fungsi, dan pengelolaan paket menggunakan pip.

Pemahaman tentang supervised learning, unsupervised learning, dan model statistik dasar membantu memahami algoritma NLP.

Instal Python 3.8 ke atas, dan gunakan virtual environment agar paket tidak bentrok. Contoh perintah:

“`

python -m venv nlp-env

source nlp-env/bin/activate # Linux/Mac

nlp-envScriptsactivate # Windows

“`

Pasang pustaka dasar untuk NLP dengan perintah:

“`

pip install spacy nltk scikit-learn tensorflow

“`

Langkah-langkah Dasar dalam NLP

Mulai dari preprocessing data teks yang bersih dan terstruktur sebelum dianalisis.

Hilangkan karakter khusus, angka, dan tanda baca yang tidak perlu. Contoh menggunakan regex:

“`python

import re

text = “Halo dunia! Tahun 2024, NLP semakin maju.”

cleaned_text = re.sub(r'[^a-zA-Zs]’, ”, text)

print(cleaned_text) # Output: Halo dunia Tahun NLP semakin maju

“`

Memecah kalimat atau paragraf menjadi kata/kumpulan kata (token). Gunakan spaCy untuk tokenisasi mudah:

“`python

import spacy

nlp = spacy.load(“en_core_web_sm”) # Untuk bahasa Inggris

doc = nlp(“Pemrosesan bahasa alami sangat menarik.”)

tokens = [token.text for token in doc]

print(tokens) # [‘Pemrosesan’, ‘bahasa’, ‘alami’, ‘sangat’, ‘menarik’, ‘.’]

“`

Stopwords adalah kata umum yang kurang signifikan seperti “dan”, “atau”, “itu”. Gunakan NLTK untuk menghilangkan stopwords:

“`python

from nltk.corpus import stopwords

import nltk

nltk.download(‘stopwords’)

stop_words = set(stopwords.words(‘indonesian’))

filtered_tokens = [w for w in tokens if w.lower() not in stop_words]

print(filtered_tokens)

“`

Stemming memotong kata ke akar katanya, sementara lemmatization mengubah kata ke bentuk dasar yang valid. Contoh lemmatization dengan spaCy:

“`python

lemmas = [token.lemma_ for token in doc]

print(lemmas)

“`

Untuk stemming, NLTK menyediakan PorterStemmer, meski kurang akurat untuk bahasa Indonesia.

Algoritma dan Model Dasar NLP

Setelah preprocessing, representasi teks dalam bentuk numerik diperlukan agar komputer dapat memprosesnya.

Model ini merepresentasikan teks sebagai kumpulan kata tanpa mempertimbangkan urutan, menghitung frekuensi kemunculan kata. Contoh dengan scikit-learn:

“`python

from sklearn.feature_extraction.text import CountVectorizer

corpus = [“Saya suka belajar NLP”, “Belajar pemrosesan bahasa alami”]

vectorizer = CountVectorizer()

X = vectorizer.fit_transform(corpus)

print(vectorizer.get_feature_names_out())

print(X.toarray())

“`

Model ini memberikan bobot pada kata berdasarkan frekuensi dan seberapa unik kata tersebut dalam korpus.

“`python

from sklearn.feature_extraction.text import TfidfVectorizer

tfidf = TfidfVectorizer()

X_tfidf = tfidf.fit_transform(corpus)

print(tfidf.get_feature_names_out())

print(X_tfidf.toarray())

“`

Model seperti Naive Bayes, SVM, dan Logistic Regression umum digunakan untuk klasifikasi teks setelah representasi numerik. Model deep learning seperti BERT semakin populer untuk pemahaman konteks lebih baik.

Tools dan Library Populer untuk NLP Pemula

Berikut pustaka utama yang wajib dikuasai:

Fokus pada kecepatan dan kemudahan integrasi. Cocok untuk tokenisasi, lemmatization, named entity recognition, dan dependency parsing.

Lengkap untuk riset dan eksperimen, menyediakan banyak dataset dan algoritma klasik.

Untuk membangun model machine learning sederhana dari data teks.

Framework deep learning untuk membangun model NLP lanjutan, termasuk model BERT.

Contoh implementasi tokenisasi dan lemmatization dengan spaCy:

“`python

import spacy

nlp = spacy.load(“en_core_web_sm”)

doc = nlp(“Pemrosesan bahasa alami meningkatkan kemampuan komputer.”)

tokens = [token.text for token in doc]

lemmas = [token.lemma_ for token in doc]

print(“Tokens:”, tokens)

print(“Lemmas:”, lemmas)

“`

Studi Kasus: Membuat Proyek NLP Sederhana — Analisis Sentimen

Berikut contoh langkah membangun model analisis sentimen sederhana menggunakan scikit-learn:

Gunakan dataset berlabel positif dan negatif. Contoh sederhana:

“`python

data = [

(“Saya sangat senang dengan produk ini”, “positif”),

(“Pelayanan buruk dan lambat”, “negatif”),

(“Kualitas barang bagus dan harga terjangkau”, “positif”),

(“Tidak puas dengan layanan pelanggan”, “negatif”)

]

texts, labels = zip(*data)

“`

Gunakan CountVectorizer untuk mengubah teks menjadi fitur numerik:

“`python

from sklearn.feature_extraction.text import CountVectorizer

vectorizer = CountVectorizer(stop_words=’indonesian’)

X = vectorizer.fit_transform(texts)

“`

Gunakan Naive Bayes untuk klasifikasi:

“`python

from sklearn.naive_bayes import MultinomialNB

model = MultinomialNB()

model.fit(X, labels)

“`

Prediksi kalimat baru:

“`python

test_text = [“Barangnya sangat bagus dan pengiriman cepat”]

test_vec = vectorizer.transform(test_text)

prediction = model.predict(test_vec)

print(“Prediksi sentimen:”, prediction)

“`

Hasil prediksi akan menunjukkan apakah kalimat tersebut positif atau negatif berdasarkan model sederhana yang sudah dilatih.

Tantangan yang Sering Dihadapi dan Tips Mengatasinya

Teks bahasa manusia penuh dengan slang, typo, dan variasi. Gunakan preprocessing yang ketat termasuk normalisasi, pembersihan, dan penghilangan stopwords.

Kumpulkan dataset lebih besar atau gunakan transfer learning dengan model besar seperti BERT yang dapat disesuaikan dengan dataset kecil.

Model statistik sederhana sulit memahami konteks kompleks. Gunakan model deep learning berbasis Transformer untuk Natural Language Understanding (NLU).

Sesuaikan algoritma dengan tujuan aplikasi dan dataset. Eksperimen dengan berbagai teknik preprocessing dan model.

Sumber Belajar dan Rekomendasi Kursus untuk Pemula

Kursus lengkap dengan materi mulai dari dasar NLP hingga deep learning untuk bahasa alami.

Modul gratis yang membahas konsep dan implementasi dasar NLP.

- spaCy: https://spacy.io/usage

- NLTK: https://www.nltk.org/

- scikit-learn: https://scikit-learn.org/stable/

- “Natural Language Processing with Python” oleh Steven Bird

- “Speech and Language Processing” oleh Daniel Jurafsky dan James H. Martin

Cari tutorial spaCy, NLTK, dan TensorFlow dari channel seperti Sentdex dan Data School untuk pembelajaran visual.

FAQ

Apa perbedaan antara stemming dan lemmatization?

Stemming memotong kata ke bentuk akar sederhana tanpa memperhatikan makna, misalnya “berlari” menjadi “lari”. Lemmatization mengubah kata ke bentuk dasar secara linguistik yang benar, misalnya “berlari” menjadi “lari” dengan mempertimbangkan konteks.

Library mana yang terbaik untuk pemula belajar NLP di Python?

spaCy dan NLTK adalah pilihan terbaik untuk pemula. spaCy lebih cepat dan mudah digunakan untuk aplikasi produksi, sedangkan NLTK lengkap untuk riset dan pembelajaran konsep dasar.

Bagaimana cara mengatasi data teks yang banyak mengandung kata slang atau typo?

Gunakan teknik normalisasi teks seperti kamus slang, pembersihan manual, dan algoritma fuzzy matching. Preprocessing yang teliti penting agar model dapat belajar dari data bersih.

Apakah perlu belajar machine learning untuk menguasai NLP?

Ya, pemahaman machine learning dasar membantu dalam memahami model klasifikasi, regresi, dan deep learning yang digunakan untuk NLP. Namun, Anda bisa mulai dari teknik preprocessing dan model statistik sederhana terlebih dahulu.

Bagaimana cara menggunakan model BERT untuk NLP?

BERT adalah model deep learning berbasis Transformer yang dapat digunakan untuk berbagai tugas NLP. Anda dapat menggunakan pustaka seperti Hugging Face Transformers untuk mengakses model BERT dan melakukan fine-tuning sesuai kebutuhan.

—

Setelah memahami teknik dasar dan tools NLP, langkah selanjutnya adalah mengembangkan proyek dengan data yang lebih besar dan menggunakan model lebih canggih. Eksperimen dengan dataset nyata dan teknologi terbaru seperti BERT akan meningkatkan kemampuan aplikasi NLP Anda dalam memahami konteks dan makna bahasa manusia secara lebih mendalam.