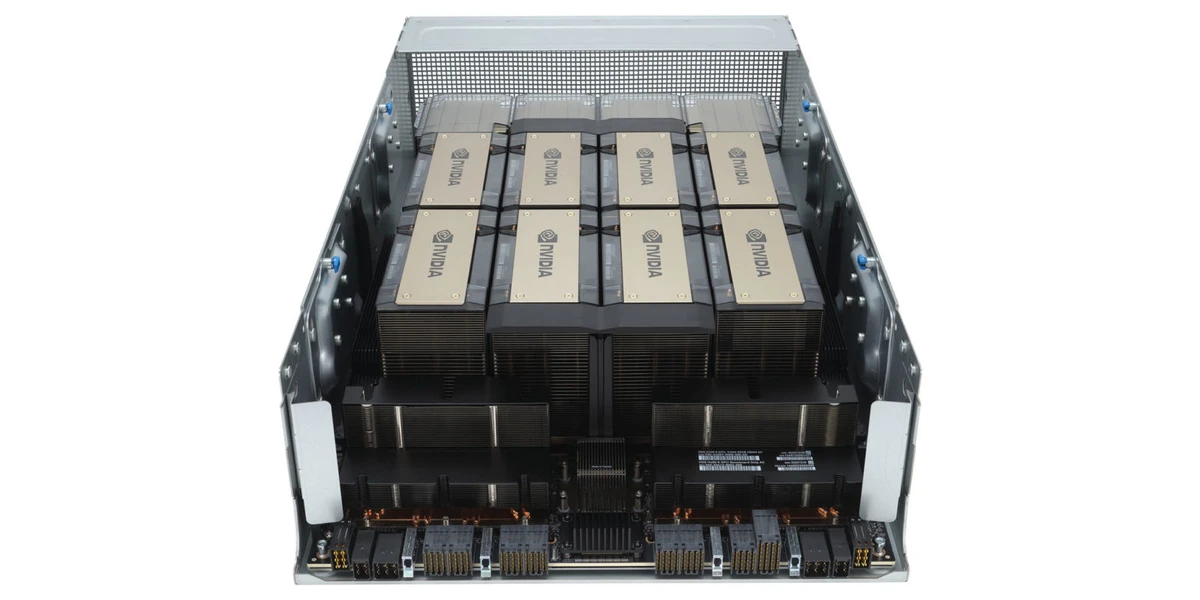

TentangAI.com – Akamai mengimplementasikan Nvidia AI Grid dengan lebih dari 10.000 GPU Nvidia RTX Pro 6000 dalam jaringan edge mereka yang tersebar di lebih dari 4.400 lokasi edge dan data center regional. Langkah ini menggeser paradigma infrastruktur AI dari model terpusat ke sistem terdistribusi, memungkinkan percepatan signifikan dalam pemrosesan inference AI secara global melalui edge computing.

| Faktor | Detail |

|---|---|

| Teknologi GPU | Nvidia RTX Pro 6000, GPU dengan arsitektur Ampere untuk AI inference dan rendering |

| Jumlah GPU | Lebih dari 10.000 unit yang dioperasikan oleh Akamai |

| Jaringan Edge | 4.400+ lokasi edge dan data center regional di seluruh dunia |

| Model Infrastruktur AI | Dari centralized ke distributed AI system |

| Fokus Utama | Distribusi workload inference AI untuk efisiensi dan latensi rendah |

Implementasi Nvidia AI Grid oleh Akamai: Arsitektur AI Terdistribusi Berskala Global

Akamai, sebagai penyedia layanan cloud dan edge computing terkemuka, mengadopsi Nvidia AI Grid dengan menggunakan ribuan GPU RTX Pro 6000 yang diintegrasikan dalam arsitektur jaringan edge dan data center regional. Teknologi Nvidia AI Grid memungkinkan Akamai untuk menyebarkan beban kerja inference AI ke sistem terdistribusi yang tersebar di lebih dari 4.400 lokasi, termasuk edge nodes dan data center regional di berbagai benua. Dengan pendekatan ini, Akamai memanfaatkan kekuatan GPU RTX Pro 6000 yang memiliki kemampuan pemrosesan paralel tinggi dan efisiensi daya optimal untuk mempercepat pengolahan model AI secara real-time.

Arsitektur terdistribusi ini dirancang untuk mengatasi keterbatasan model AI terpusat yang biasanya mengalami bottleneck pada bandwidth dan latensi jaringan. Dengan menempatkan GPU RTX Pro 6000 lebih dekat ke titik data dan pengguna akhir, Akamai mengurangi waktu respons inference AI secara signifikan, yang sangat krusial untuk aplikasi edge computing seperti pengenalan wajah, analisis video, dan otomasi industri. Implementasi ini juga memberikan skalabilitas jaringan yang lebih baik dengan mendistribusikan workload inference ke edge locations yang secara geografis lebih dekat ke sumber data.

Dampak Edge Computing dalam Mempercepat Pemrosesan Inference AI

Edge computing menjadi fondasi utama dalam strategi pengembangan infrastruktur AI terdistribusi Akamai. Dengan memindahkan proses inference AI dari pusat data terpusat ke jaringan edge yang lebih luas, latensi komunikasi berkurang drastis, memungkinkan aplikasi real-time yang memerlukan respon cepat dapat berjalan dengan optimal. Nvidia RTX Pro 6000 yang digunakan di edge locations mendukung beban kerja AI yang kompleks, seperti deep learning inference dan model machine learning besar, tanpa ketergantungan tinggi pada koneksi internet ke data center utama.

Distribusi workload inference AI di jaringan regional juga meningkatkan efisiensi penggunaan sumber daya komputasi. Akamai dapat mengalokasikan GPU secara dinamis berdasarkan kebutuhan lokasi dan jenis aplikasi, yang berkontribusi pada pengurangan biaya operasional dan peningkatan performa. Selain itu, pendekatan ini mendukung redundansi dan ketahanan sistem dengan meminimalkan risiko single point of failure yang biasa terjadi pada model terpusat.

Keunggulan Nvidia RTX Pro 6000 dalam Infrastruktur Server AI

Nvidia RTX Pro 6000 merupakan GPU kelas profesional yang didesain khusus untuk kebutuhan AI inference dan rendering grafis tingkat tinggi. GPU ini menggunakan arsitektur Ampere terbaru yang mengintegrasikan Tensor Cores generasi keempat, memungkinkan percepatan signifikan dalam pengolahan tensor dan operasi matematika kompleks yang menjadi inti dari model AI modern. Dengan memori kapasitas besar dan bandwidth tinggi, RTX Pro 6000 mampu menampung model AI besar serta mempercepat eksekusi inference secara paralel.

Jika dibandingkan dengan sistem AI terpusat tradisional yang biasanya mengandalkan sejumlah kecil GPU di pusat data besar, penggunaan RTX Pro 6000 dalam jaringan edge terdistribusi menawarkan beberapa keunggulan teknis. Pertama, latensi komunikasi berkurang secara drastis karena data tidak perlu dikirim ke pusat data jauh. Kedua, kapasitas komputasi yang tersebar memungkinkan skalabilitas horizontal yang lebih mudah dan fleksibel. Ketiga, distribusi GPU mendukung workload yang lebih heterogen dan adaptif terhadap kebutuhan aplikasi di berbagai sektor industri.

Prospek Pengembangan Infrastruktur AI Terdistribusi Global

Transformasi infrastruktur AI yang dilakukan oleh Akamai dan Nvidia menandai tonggak penting dalam evolusi teknologi edge computing dan server AI berbasis GPU. Dengan menyebarkan lebih dari 10.000 GPU RTX Pro 6000 ke ribuan lokasi edge dan data center regional, mereka tidak hanya meningkatkan kecepatan dan efisiensi pemrosesan inference AI, tetapi juga membuka jalan bagi aplikasi AI yang lebih luas dan kompleks di tingkat global.

Ke depan, pendekatan distributed AI infrastructure seperti ini berpotensi mengubah lanskap teknologi dengan menyediakan solusi AI yang lebih responsif, tahan gangguan, dan hemat biaya. Hal ini sangat relevan dalam konteks meningkatnya permintaan akan layanan AI real-time di berbagai sektor, termasuk telekomunikasi, otomotif, kesehatan, dan manufaktur. Ekspansi jaringan edge yang didukung GPU berkinerja tinggi juga menjadi kunci untuk memenuhi kebutuhan AI yang terus berkembang dengan latensi rendah dan throughput tinggi.

Pemanfaatan Nvidia AI Grid oleh Akamai juga memberikan sinyal kuat bahwa kombinasi perangkat keras GPU canggih dengan arsitektur jaringan edge yang matang dapat mempercepat adopsi AI secara masif dan merata. Inovasi ini menandai pergeseran dari model centralized AI yang rentan terhadap kemacetan dan keterbatasan kapasitas, menuju sistem distributed AI yang lebih adaptif dan scalable.

—

Langkah strategis Akamai dalam mengintegrasikan Nvidia RTX Pro 6000 ke dalam infrastruktur edge computing global menunjukkan bagaimana teknologi GPU profesional dapat menjadi tulang punggung untuk mempercepat evolusi AI inference secara luas. Dengan jaringan edge yang tersebar di ribuan lokasi dan dukungan ribuan unit GPU, mereka menciptakan ekosistem AI terdistribusi yang efisien dan siap menghadapi tantangan komputasi masa depan.